AIエンジニアが毎日チェックする情報収集サイト17選【2026年最新】

この記事で得られること: LLM・生成AIの最前線を追うために、現役AIエンジニアが実際に毎日使っている情報源を17サイト厳選して紹介します。SNSではなく「一次情報」に絞り、速く・正確に・ノイズ少なく情報を収集する方法も合わせて解説します。

結論:AIエンジニアの情報収集は「一次情報×RSS管理」が最短ルート

AIの進化スピードは、ブログやSNSで「まとめ記事」を読んでいるだけでは追いつけません。Twitterでバズった情報を見ていると「2日遅れ」「内容が変質している」ことが頻繁に起きます。

実際の現場では、以下の3つの課題が生じます:

- 情報の鮮度問題:二次情報(まとめ記事・SNS)は元の発表から数日遅れる

- ノイズ問題:SNSは「話題性」が優先されるため、技術的に重要な情報が埋もれる

- 継続性の問題:ブックマークでの巡回は習慣化しにくく、見落としが発生する

解決策は「一次情報源を特定し、RSSで統合管理する」ことです。

本記事では、AIエンジニアとして実際に価値を感じている17サイトを5カテゴリに分けて紹介し、効率的な情報収集体制の作り方まで解説します。

用語補足:一次情報とは

企業・研究機関が直接発表する公式ブログ・論文・リリースノートのこと。Twitterやニュースサイトによる「解説・要約」は二次情報にあたります。一次情報を直接読む習慣がエンジニアとしての精度を上げます。

カテゴリ1:研究・モデル発表系(主要ラボの公式ブログ)

AIの方向性と技術的な意思決定を把握するために、主要ラボの公式ブログを直接追います。

1. OpenAI公式ブログ — GPT系・推論モデルの動向

URL: https://openai.com/news/company-announcements/

OpenAIの動きは業界全体の設計判断に直結します。特に APIの仕様変更は見逃すとプロダクトに直接影響が出るため、必須の確認先です。

| チェックポイント | 内容 |

|---|---|

| モデルアップデート | GPT-4o・o1系の仕様変更 |

| API変更通知 | 破壊的変更の事前把握 |

| 研究発表 | 推論・マルチモーダルの方向性確認 |

実体験から: o1のプロンプトキャッシュ仕様変更がSNSで話題になったのは発表から2日後でしたが、公式ブログをRSSで追っていたため翌朝には把握できていました。プロダクトのコスト計算に関わる変更だったので、早期検知の価値は大きかったです。

2. Anthropic公式ブログ — Claude・Alignment研究

URL: https://www.anthropic.com/news

Anthropicは研究の透明性が高く、公開されるテクニカルレポートの品質が高いです。Alignment(AI安全性)分野の一次情報として最重要ソースの一つです。

| チェックポイント | 内容 |

|---|---|

| Claudeアップデート | モデル性能・コンテキスト長の変化 |

| Alignment研究 | Constitutional AIなどの安全性研究 |

| 推論効率 | 速度・コスト改善の動向 |

用語補足:Constitutional AI(憲法的AI)とは

Anthropicが提唱するAIの安全性確保手法。モデルに「原則(憲法)」を与え、自己修正させながら学習させる手法です。RLHF(人間フィードバック強化学習)の代替・補完として注目されています。

3. Google DeepMind公式ブログ — 基礎研究・マルチモーダル

URL: https://deepmind.google/blog/

DeepMindは純粋な研究発表の質が高く、3〜5年後の技術動向を先読みするうえで欠かせないソースです。

| チェックポイント | 内容 |

|---|---|

| マルチモーダル研究 | Gemini系の基礎研究 |

| 強化学習 | AlphaFold等の応用研究 |

| 基礎研究 | 長期的なAIアーキテクチャの方向性 |

長期的なアーキテクチャ設計の判断材料として、毎週確認する価値があります。

4. Meta AI公式ブログ — Llamaシリーズ・OSS戦略

URL: https://ai.meta.com/blog/

MetaはOSSでモデルを公開するため、fine-tuneや自社インフラへの組み込みを検討するエンジニアには最重要ソースです。

| チェックポイント | 内容 |

|---|---|

| Llamaシリーズ | オープンウェイトモデルの最新動向 |

| SAM / Segment Anything | 画像・マルチモーダル研究 |

| Production OSS | 実用的なOSSの公開タイミング |

用語補足:オープンウェイトモデルとは

モデルの重み(パラメータ)が公開されているモデルのこと。OpenAIのGPTはAPIのみ提供ですが、MetaのLlamaはウェイトを公開しており、ローカル環境でのfine-tuneや改変が可能です。

5. Sakana AI — 日本発AIスタートアップの動向

東京発のAI研究スタートアップとして、国際的にも注目される研究を発信しています。進化的アルゴリズムを使ったモデル自動設計の研究は他にないユニークな切り口です。

日本語圏のAIエンジニアとして、国内スタートアップの研究動向を把握しておくことは重要です。

6. Preferred Networks — 埋め込み・翻訳系基盤モデル

URL: https://tech.preferred.jp/ja/blog/

日本語でのAI技術ブログとして質が高く、ロボティクス・製造業向けAIの産業応用についての知見が得られます。国内での基盤モデル研究の動向を追うのに適しています。

カテゴリ2:論文・モデル探索系

研究の最前線を把握するには、論文を「探す」より「流れに乗って追う」設計が重要です。

7. Hugging Face Papers — 最新AI論文の一覧

URL: https://huggingface.co/papers

AIの主要論文が集約されており、実装リンクやモデルカードへのアクセスが容易です。論文読みの出発点として最も効率が高いサイトの一つで、arXivよりノイズが少なく整理されているのが特徴です。

用語補足:モデルカードとは

Hugging Face上の各モデルに付属するドキュメント。モデルのアーキテクチャ、学習データ、ライセンス、使用制限などが記載されています。プロダクトへの組み込み可否を判断する際の最初の確認先です。

8. Hugging Face Trending Papers — 話題の論文だけ追う

URL: https://huggingface.co/papers/trending

コミュニティでいま最も話題になっている論文を絞り込みで確認できます。時間がないときのダイジェスト的な活用に向いています。

毎朝5分で確認するルーティンとして最適です。Trendingに上がっている論文はたいてい翌日にはSNSで話題になるため、「一歩先を知っている状態」を維持できます。

9. arXiv — 一次論文の最速公開場所

URL: https://arxiv.org/

査読前の最新論文が公開されるため、情報の鮮度は最高です。ただしノイズも多いため、Hugging Face Papersと使い分けるのがおすすめです。

追うべきカテゴリ:

cs.AI(人工知能)cs.CL(自然言語処理)cs.LG(機械学習)

arXivの注意点

arXivは査読なしで投稿できるため、再現性に問題がある論文や誇大な主張を含む論文も混在します。有力な論文かどうかは、引用数・著者の所属・Hugging Face Papersでの評価を参考に判断してください。

カテゴリ3:実装・Fine-tune・応用系

研究を「自分のプロダクトで動かす」フェーズで必要な実装情報を収集します。

10. Unsloth — LoRA高速化・低VRAM学習

LoRAを使ったLLMのfine-tuneを低VRAMで効率的に行うためのノウハウが豊富です。特に個人・小規模チームでの学習実験を行うエンジニア向けに実践的な情報が多いです。

主なトピック:

- LoRA高速化の実装手法

- 低VRAM環境でのfine-tune

- QLoRAなど量子化を使った学習

用語補足:LoRA(Low-Rank Adaptation)とは

大規模モデルを少ないパラメータで効率的にfine-tuneする手法。モデル全体を更新する代わりに、小さな「差分行列」を学習させます。これにより、RTX 3090レベルのGPUでもLlamaのfine-tuneが現実的になります。

実際の活用シーン: 日本語対話データでのfine-tune実験時、通常の学習では24GBのVRAMでもOOMが出ていたところ、UnslothのQLoRA実装を使うことで同じモデルを12GBで学習できるようになりました。

# UnslothでのQLoRA fine-tuneの基本構成(概要)

from unsloth import FastLanguageModel

model, tokenizer = FastLanguageModel.from_pretrained(

model_name="unsloth/llama-3-8b-bnb-4bit", # 4bit量子化モデル

max_seq_length=2048,

dtype=None,

load_in_4bit=True,

)

model = FastLanguageModel.get_peft_model(

model,

r=16, # LoRAのランク(低いほど軽量)

lora_alpha=16,

lora_dropout=0,

bias="none",

)

11. ElevenLabs公式ブログ — STT/TTS・音声AI

URL: https://elevenlabs.io/blog

音声AI(Speech-to-Text / Text-to-Speech)の最新動向とAPI変更を追えます。音声系プロダクトを開発するエンジニアには必須ソースです。

用語補足:STT / TTS とは

- STT(Speech-to-Text):音声を文字に変換する技術。音声認識。

- TTS(Text-to-Speech):テキストを音声に変換する技術。音声合成。

ElevenLabsはTTSの品質が高く、感情表現・多言語対応でリードしています。

カテゴリ4:OSS・トレンド観測系

「これから伸びるOSS」を早期に発見するための観測ポイントです。

12. GitHub Trending — 伸びているOSSの早期発見

URL: https://github.com/trending

LLMツールやエージェント系プロジェクトが急速にスターを集める様子をリアルタイムで確認できます。新しいOSSが話題になる前に把握するのに最適です。

フィルタリングのコツ:

- 言語で絞る:

Python/TypeScript - 期間で絞る:

Today→ 急上昇の発見、This week→ トレンドの把握

LangChain、LlamaIndex、Difyなど今では広く使われているフレームワークも、GitHub TrendingのPythonカテゴリから最初に発見するケースが多いです。

13. Open Source Projects — OSS横断フィード

URL: https://www.opensourceprojects.dev/feed.xml

RSS対応のOSS情報フィード。複数ソースを横断してOSSの動向をまとめて追えます。GitHub Trendingと合わせて使うことで、見落としを減らせます。

カテゴリ5:コミュニティ・兆し観測系

「バズる前の兆し」はコミュニティで最初に現れます。実装者の生の議論を観察する場として活用します。

14. Hacker News — バズる前の議論

URL: https://news.ycombinator.com/

AIスタートアップや新技術が話題になる最初の場所の一つ。実装者・研究者視点のコメントが充実しており、メディア記事より深い情報が得られます。

活用のコツ:

- 「Ask HN」「Show HN」タグの投稿は特に質が高い

- コメント欄に実際の実装者・著者が降臨することも多い

- 「なぜこの技術が使えないか」の批判的視点も価値がある

15. Reddit(r/MachineLearning・r/LocalLLaMA)— 生の議論・研究共有

| サブレディット | 特徴 |

|---|---|

| r/MachineLearning | 研究者・エンジニアの議論、論文著者が直接回答することも |

| r/LocalLLaMA | ローカルLLMの実装情報、量子化・ハードウェア比較が豊富 |

| r/singularity | AIトレンドの兆し観測、やや過激だがトレンド感度は高い |

r/LocalLLaMAは特に実用情報が豊富で、「GGUF形式とGGMLの違い」「特定モデルのベンチマーク比較」など、ドキュメントには載っていない実践知が集まっています。

用語補足:GGUF形式とは

ローカルLLM実行ライブラリ「llama.cpp」が採用するモデルファイル形式。量子化(精度を落としてファイルサイズを削減)したモデルの配布に使われます。Q4_K_M、Q8_0など精度レベルを指定して利用します。

16. Zenn(AIトピック) — 日本語圏の実装情報

URL: https://zenn.dev/topics/ai/feed

日本語でのAI実装記事が集まる場所。海外情報のキャッチアップだけでなく、日本語処理・ローカライズ特有の課題についての情報収集に向いています。

国内エンジニアの第一人者が書いたハンズオン記事が多く、英語論文の実装ハードルを下げる補助として活用できます。

17. note(AIタグ) — 日本語圏のビジネス視点

URL: https://note.com/hashtag/AI

Zennが実装寄りなのに対し、noteはAIのビジネス応用・プロダクト設計の視点が多い。AIエンジニアとしてビジネス判断にも関わる立場であれば、補完的に活用できます。

実践:RSSで17サイトを統合管理する方法

ここまで紹介した17サイトを毎日個別に巡回するのは現実的ではありません。

| 課題 | 内容 |

|---|---|

| 更新頻度 | arXivは毎日数十件以上の新着 |

| ノイズ | 重要情報がSNSのバズと同列に流れる |

| 習慣化 | ブックマーク巡回は意志力に依存し続かない |

解決策:RSSリーダーで一元管理する

主要サイトのRSS URL一覧

# 研究・モデル発表系

https://openai.com/news/rss.xml

https://www.anthropic.com/rss.xml

https://deepmind.google/blog/rss.xml

https://ai.meta.com/blog/rss/

https://sakana.ai/blog/rss.xml

https://tech.preferred.jp/ja/feed/

# 論文・モデル探索系

https://huggingface.co/papers/rss

# 実装・応用系

https://unsloth.ai/blog/rss

https://elevenlabs.io/blog/rss

# OSS・トレンド観測系

https://www.opensourceprojects.dev/feed.xml

# コミュニティ系

https://news.ycombinator.com/rss

https://zenn.dev/topics/ai/feed

RSSリーダーの選択肢

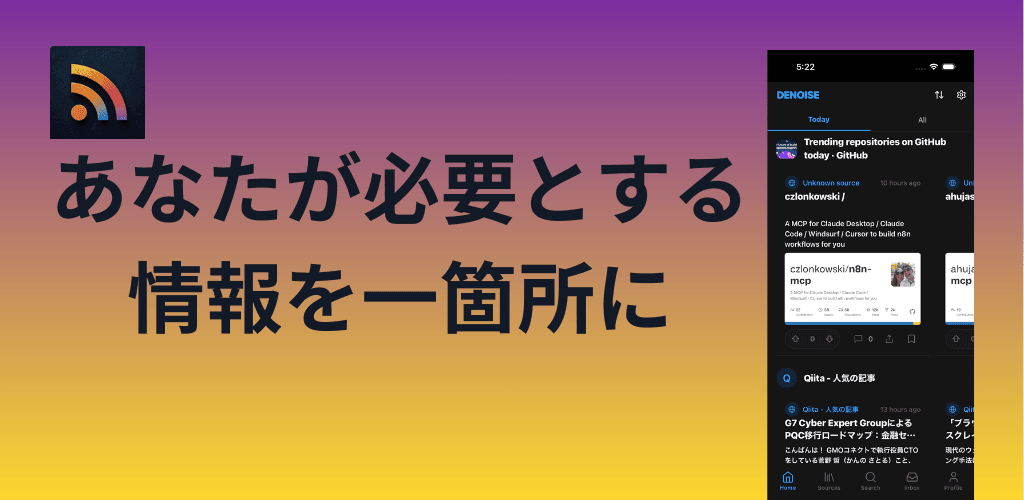

Denoise — AIエンジニア向け情報収集アプリ

海外AI・LLM関連ソースに特化した情報整理ツール。SNSに依存しない一次情報環境を作ることを目的として設計されています。

- iOS: https://apps.apple.com/jp/app/denoise/id6757993217

- Android: https://play.google.com/store/apps/details?id=com.neosophie.denoise

特徴:

- AI・LLM関連ソースにフォーカスした設計

- ノイズを削ぎ落とした静かな情報空間

- 情報を効率よく俯瞰できるUI

Feedly — 汎用RSSリーダー

URL: https://feedly.com/

老舗の汎用RSSリーダー。AI以外の分野も含めて幅広く情報収集したい場合の選択肢。カテゴリ管理が充実しており、AI要約機能も備えています。

情報収集の運用設計:実際のルーティン例

17サイトを毎日全量チェックするのは非効率です。以下のように時間軸で優先度を分けるのが現実的です。

毎日(5〜10分)

- Hugging Face Trending Papers:今日話題の論文をタイトルだけ確認

- GitHub Trending(Python、Today):急上昇プロジェクトを確認

- Hacker News:スコア上位10件のタイトルを確認

週2〜3回(15〜20分)

- OpenAI・Anthropic・DeepMind公式ブログ:新規投稿を全文確認

- r/LocalLLaMA・r/MachineLearning:Hot投稿のコメントを流し読み

週1回(30分)

- arXiv(cs.CL・cs.LG):週の注目論文をabstractで確認

- Unsloth・ElevenLabs:実装に関わるアップデートがあれば精読

- Zenn AIトピック:国内の実装記事を確認

「全部読もうとしない」が重要

情報収集の最大の失敗パターンは「完璧に読もうとして挫折すること」です。タイトルと概要だけを流し見して、自分のプロジェクトに関係ありそうなものだけ精読する設計にすることで長続きします。

まとめ:AIエンジニアの情報収集に必要な3原則

本記事で紹介した内容を構造化すると、以下の3原則に集約されます。

原則1:一次情報源を直接追う

SNSやまとめサイトを経由せず、公式ブログ・論文サイト・OSSリポジトリを直接観察する。情報の速度と正確性が上がります。

原則2:RSSで習慣コストを下げる

「見に行く」設計ではなく「流れてくる」設計にする。意志力に依存しない仕組みを作ることで継続できます。

原則3:全量消化しない設計にする

情報は収集するのではなく観測するもの。重要度に応じた処理深度を決め、タイトル確認だけで十分なものと精読すべきものを分けます。

| カテゴリ | 代表サイト | 役割 |

|---|---|---|

| 研究・モデル発表系 | OpenAI, Anthropic, DeepMind | 業界の方向性を把握 |

| 論文・モデル探索系 | HF Papers, arXiv | 技術の最前線を追う |

| 実装・応用系 | Unsloth, ElevenLabs | プロダクトに活かす |

| OSS観測系 | GitHub Trending | 新ツールを早期発見 |

| コミュニティ系 | HN, r/LocalLLaMA, Zenn | 兆しを察知する |

FAQ:よくある質問

Q. 全部のサイトを毎日チェックする必要がありますか?

必要ありません。「毎日チェックすべきもの」は実質3〜4サイトです(Hugging Face Trending、GitHub Trending Today、HN)。残りは週次・月次で十分です。重要な発表はコミュニティで話題になるため、週次チェックでも見落としは少ないです。

Q. Twitterで十分ではないですか?

プロダクション品質の判断をするには不十分です。理由は3つあります。①情報が2〜3日遅れる、②仕様の誤読・誇張が含まれる、③APIの破壊的変更など「地味だが重要な情報」がバズらない。一次情報源をRSSで追うことで、これら全てを解消できます。

Q. arXivの論文は英語ばかりで読めません。どうすればいいですか?

Abstract(要約)だけ読む習慣から始めてください。最初の4〜5文に「何を提案したか」「何が改善されたか」が凝縮されています。DeepL + ChatGPTでAbstractを日本語要約するだけでも、論文の価値判断は十分できます。精読は自分のプロジェクトに直接関係するものだけに絞る設計が持続可能です。

Q. 日本語の情報だけで追いかけることはできますか?

半年以上のタイムラグが生じるため、推奨できません。重要なモデル発表・API変更・研究成果は英語の一次情報で出てくるため、英語の壁を感じる場合は「英語でタイトルと概要だけ確認し、気になるものだけ翻訳ツールで読む」設計が現実的です。

Q. RSSリーダーは有料でないと使えませんか?

Feedlyは無料プランで100フィードまで管理できます。本記事で紹介した17サイト程度であれば無料で十分です。Denoiseはより特化した体験を提供しています。用途に応じて使い分けてください。

Q. GitHub TrendingはRSSで取得できますか?

GitHub公式ではRSSフィードが廃止されています。ただし https://github-trending-api.wahensley.workers.dev/ などの非公式APIや、特定のサードパーティサービスを使うと取得できます。あるいはDenoiseのようにGitHub Trendingを統合しているアプリを使う方法もあります。

最後に

AIの情報収集は「量」ではなく「構造」で差がつきます。本記事で紹介した設計を参考に、自分のプロジェクトと学習目標に合わせたカスタム情報環境を作ってみてください。

関連するブログ

この記事に近いテーマのブログをピックアップしています。

WER・CERだけでは不十分?日本語音声認識を「名詞・固有名詞F1スコア」で再評価した結果

日本語音声認識は漢字や固有名詞の表記多く他言語に比べて難しい。そこで、WERやCERでは見えにくい「漢字・固有名詞の認識精度」を定量化するために、Sudachiによる形態素解析ベースのF1スコア評価を実装し、オープンソース音声認識モデル9種を再評価した一次ベンチマーク記事です。

記事を読む →【2026年最新】日本語音声認識(ASR / STT)モデル比較:Whisper・Qwen3・Cohere・Graniteをベンチマーク

RTX5090を使い最新の日本語ASRモデルを同一条件でベンチマークした結果、精度・安定性ともにqwen/qwen3-asr-1.7b(WER: 0.1899)とwhisper(WER: 0.2099)が頭一つ抜け出しました。速度最優先ならparakeet-tdt-0.6b-v3(RTF: 0.002)、日本語メディア特化ならreazonspeech-espnet-v2が有力な選択肢です。WER評価にはMeCab分かち書き+句読点除去による正規化を実装し、モデル間の公平な比較を実現しています。

記事を読む →